Det er ihvertfall det skaperne ønsker å overbevise investorene om...Med denne AI og dens like har vi åpnet Pandoras eske har jeg på følelsen av. Dette lar seg ikke reversere, heller akselerere over i uante dimensjoner.

Forsterkere Om bruk av ChatGPT

- Trådstarter Alabama

- Startdato

- Ble medlem

- 11.05.2004

- Innlegg

- 2.517

- Antall liker

- 1.180

Poenget var mer hva menneskelighet egentlig er? Hva er det vi egentlig projiserer? Er det mulig å forstå det menneskelige aspekt bedre i lys av AI?Du latet til å være opptatt av å projiere menneskelighet inn i en chatbot, så ja.Kanskje du fotstår ditt eget poeng bedre... Trenger egentlig ikke se mer enn 5-10 minutter før du skjønner tegninga.

P.S.har ikke sett videoen du refererer til

Dette er til dels veldig annerledes enn min erfaring. Jeg får ofte «beklager, jeg har tatt feil» eller «det var et viktig poeng» type svar når jeg bruker dette i mitt daglige virke. Men, så opplever jeg like ofte at den går i sirkel. Da må man stort sett bare begynne dialogen på nytt og gjerne med en litt annen vinkling. Feilfritt? Neppe. Nyttig? Ja, definitivt! Det er som med alle verktøy; de må brukes riktig og har sine begrensninger.Problemet med denne strategien er at det ikke fungerer som et menneske, der en har en eller annen formening i utgangspunktet (dvs en idé om hva som er sant) som en så prøver å formidle i språk. LLMer begynner ikke der, men med å formulere et språklig svar som ut fra sannsynlighetsberegning bør nærme seg noe et menneske kunne svart, basert på treningsdata. Det innebærer at om en utfordrer LLMen, så vil en bare gå nye runder med sannsynlighetsberegning, og ikke komme nærmere hva den "egentlig" mener - for noe sånt fins ikke.

Sist redigert:

Jeg skriver egentlig ikke om erfaringer, men om hvordan maskinen fungerer. Du får jo bare "beklager, jeg har tatt feil" fordi du har insistert på at det maskinen spyttet ut ikke var riktig. Det er en direkte respons på det du skriver, sammenstilt med treningsgrunnlaget og en haug med regler som skal passe på at resultatet blir mer spiselig for en menneskelig leser. Det hele er et resultat av sannsynlighetsregning, som det beskrives i lenken fra @weld77 på forrige side.

Den prosessen du beskriver er vel egentlig en måte for deg å komme frem til et svar du på forhånd vet er riktig, eller er klar til å akseptere? Det vil jo ikke fungere om du ikke vet svaret på forhånd, for da har du jo ingen mulighet til å vurdere om den har tatt feil eller om det er riktig at du har et "viktig poeng".

Den prosessen du beskriver er vel egentlig en måte for deg å komme frem til et svar du på forhånd vet er riktig, eller er klar til å akseptere? Det vil jo ikke fungere om du ikke vet svaret på forhånd, for da har du jo ingen mulighet til å vurdere om den har tatt feil eller om det er riktig at du har et "viktig poeng".

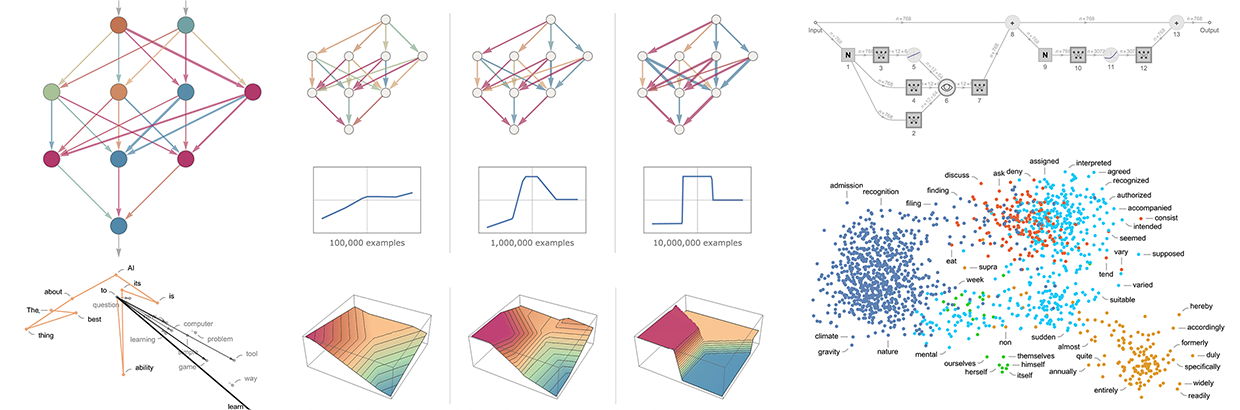

Enig , god artikkel. Holder på med den, litt lang men gir god innsikt.vi har strengt tatt en egen tråd om disse modellene, men for den som ikke leser den så minner jeg nok en gang om denne artikkelen. Den er nå tre år gammel, og den er veldig lang, men det er noe av det beste jeg har lest om hvordan disse modellene funker på innsiden

What Is ChatGPT Doing … and Why Does It Work?

Stephen Wolfram explores the broader picture of what's going on inside ChatGPT and why it produces meaningful text. Discusses models, training neural nets, embeddings, tokens, transformers, language syntax.writings.stephenwolfram.com

Nemlig, derfor synes jeg LLM er genial til å la meg føre en samtale med meg selv, ha noe å teste ideer mot selv om den tidvis misforstår og halve økten går til å forklare forutsettningene.Den prosessen du beskriver er vel egentlig en måte for deg å komme frem til et svar du på forhånd vet er riktig, eller er klar til å akseptere? Det vil jo ikke fungere om du ikke vet svaret på forhånd, for da har du jo ingen mulighet til å vurdere om den har tatt feil eller om det er riktig at du har et "viktig poeng".

Er redd vi på kort sikt får informasjon/tjenester av redusert kvalitet grunnet menneskers litt lettbeinte forhold til LLM. Særlig folk i akademia og adminstrasjon later til å omfavne teknologien litt ukritisk.

Det handler nok også om hvordan man spør. Unngå generelle spørsmål, lag avgrensninger og sett kriterier.

Mitt spørsmål til Qwen:

Kildene den brukte:

Svar fra Qwen, før ev. videre bearbeiding:

# Parasound Halo JC5 Amplifier Comparison Analysis

Based on reviews, measurements, and articles from recognized audio publications including *SoundStage! Hi-Fi*, *Hi-Fi News*, *Stereophile*, *audioXpress*, and *Part-Time Audiophile*, here is a comprehensive comparison of the Parasound Halo JC5 against comparable high-end stereo power amplifiers.

Key Specifications Comparison Table

*Sources: [[2]] SoundStage! Hi-Fi; [[4]] AudioBacon; [[13]] Hi-Fi News Lab Report; [[16]] Upscale Audio; [[17]] EQ Audio; [[19]] AudioBacon; [[21]] Upscale Audio; [[26]] audioXpress; [[50]] Part-Time Audiophile; [[54]] McIntosh; [[56]] McIntosh Manual; [[57]] Paragon Sight & Sound; [[65]] Pass Labs; [[67]] Audio Connection; [[68]] Future Audiophile; [[70]] Benchmark/ASR; [[71]] Dagogo; [[75]] Stereophile; [[81]] KJ West One; [[83]] Audio Advisor; [[84]] Polk Audio Forum; [[85]] Hans Audio PDF*

---

Where the Parasound Halo JC5 Outperforms Competitors

1. Raw Power Delivery & Current Capability

2. Class A Bias Range

3. Value Proposition

4. Practical Features

5. Measured Low-Frequency Extension

Where the Parasound Halo JC5 Underperforms or Makes Trade-offs

1. Absolute Measurement Precision

2. Weight and Physical Footprint

3. Channel Matching Precision

4. Power Supply Limitations on Mains

5. Ultra-Low Noise Floor

Critical Reception Summary from Recognized Publications

Conclusion

The Parasound Halo JC5 occupies a distinctive position in the high-end amplifier market. It delivers exceptional power, current capability, and Class A refinement at a price point significantly below competitors offering similar performance. While it does not achieve the absolute measurement extremes of specialized designs like the Benchmark AHB2, its performance remains far below audible thresholds and is praised for musicality, dynamics, and system compatibility.

Best suited for: Audiophiles seeking high-power, high-current amplification with Class A refinement for difficult speaker loads, who value practical features (gain controls, bridging) and exceptional value without compromising sonic excellence.

Consider alternatives if: You require ultra-compact size, the absolute lowest possible noise floor for horn/efficiency speakers, or prefer the specific sonic signatures of McIntosh's autoformer topology or Pass Labs' single-ended purity.

All specifications and assessments sourced from independent, recognized audio publications. Measurements reflect laboratory testing under controlled conditions; real-world performance may vary with system configuration and listening environment.

Mitt spørsmål til Qwen:

Kildene den brukte:

Svar fra Qwen, før ev. videre bearbeiding:

# Parasound Halo JC5 Amplifier Comparison Analysis

Based on reviews, measurements, and articles from recognized audio publications including *SoundStage! Hi-Fi*, *Hi-Fi News*, *Stereophile*, *audioXpress*, and *Part-Time Audiophile*, here is a comprehensive comparison of the Parasound Halo JC5 against comparable high-end stereo power amplifiers.

Key Specifications Comparison Table

| Specification | Parasound Halo JC5 | McIntosh MC312 | Pass Labs X250.8 | Bryston 4B³ | Benchmark AHB2 |

|---|---|---|---|---|---|

| Price (USD) | $5,995 www.soundstagehifi.com | ~$10,000 www.mcintoshlabs.com | ~$10,500 www.passlabs.com | $5,695 www.audioadvisor.com | ~$3,000 benchmarkmedia.com |

| Power Output (8Ω, both channels) | 400W www.hifinews.com | 300W www.mcintoshlabs.com | 250W www.passlabs.com | 300W www.kjwestone.co.uk | 100W www.stereophile.com |

| Power Output (4Ω, both channels) | 600W (spec) / 700W (measured) www.hifinews.com | 300W www.paragonsns.com | 500W futureaudiophile.com | 500W forum.polkaudio.com | 190W www.dagogo.com |

| Dynamic Power (8/4/2/1Ω) | 515W/960W/1680W/1180W www.hifinews.com | Not specified | Not specified | Not specified | Not specified |

| Class A Operation | Up to 12W/channel audiobacon.net | Not specified | Up to ~14W futureaudiophile.com | Not specified | Class AH (hybrid) benchmarkmedia.com |

| THD+N (1kHz, rated power) | 0.0075% @ 100W www.hifinews.com | 0.005% www.paragonsns.com | Not specified | 0.005% www.hansaudio.nl | 0.00016% benchmarkmedia.com |

| Frequency Response | 1Hz–48kHz (±1dB) www.hifinews.com | 20Hz–20kHz ±0.25dB www.mcintoshlabs.com | 1.5Hz–100kHz audioconnection.com.au | 20Hz–20kHz ±0.25dB www.hansaudio.nl | 0.1Hz–200kHz www.dagogo.com |

| Output Impedance | ~0.02Ω www.hifinews.com | Not specified | Not specified | Not specified | 0.09Ω @ 20Hz www.stereophile.com |

| S/N Ratio (A-wtd, ref 400W) | 115.7dB www.hifinews.com | 120dB www.paragonsns.com | Not specified | >119dB www.hansaudio.nl | ~128.5dB (dynamic range) www.stereophile.com |

| Peak Current | 90A/channel audiobacon.net | Not specified | Not specified | Not specified | Not specified |

| Weight | 73 lb (33.1 kg) upscaleaudio.com | ~130 lb pt.audio | 100 lb www.passlabs.com | ~70 lb (est.) | 13.5 lb benchmarkmedia.com |

| Dimensions (W×H×D) | 17.63"×7.13"×20" upscaleaudio.com | 16.5"×9.5"×18.5" www.mcintoshlabs.com | 19"×7.5"×18.5" www.passlabs.com | 17"×6.5"×17" www.kjwestone.co.uk | 10.75"×3.5"×13.5" benchmarkmedia.com |

| Bridged Mono Option | Yes, 1,200W @ 8Ω eqaudio.ca | No | No | Yes www.kjwestone.co.uk | Yes, 380W @ 8Ω www.dagogo.com |

| Gain Controls | Yes, per channel audioxpress.com | No | No | No | Sensitivity switches www.stereophile.com |

| Input Options | Balanced XLR, Unbalanced RCA upscaleaudio.com | Balanced/Unbalanced www.paragonsns.com | Balanced XLR, Unbalanced RCA www.passlabs.com | Balanced/Unbalanced www.kjwestone.co.uk | Balanced XLR only benchmarkmedia.com |

*Sources: [[2]] SoundStage! Hi-Fi; [[4]] AudioBacon; [[13]] Hi-Fi News Lab Report; [[16]] Upscale Audio; [[17]] EQ Audio; [[19]] AudioBacon; [[21]] Upscale Audio; [[26]] audioXpress; [[50]] Part-Time Audiophile; [[54]] McIntosh; [[56]] McIntosh Manual; [[57]] Paragon Sight & Sound; [[65]] Pass Labs; [[67]] Audio Connection; [[68]] Future Audiophile; [[70]] Benchmark/ASR; [[71]] Dagogo; [[75]] Stereophile; [[81]] KJ West One; [[83]] Audio Advisor; [[84]] Polk Audio Forum; [[85]] Hans Audio PDF*

---

Where the Parasound Halo JC5 Outperforms Competitors

1. Raw Power Delivery & Current Capability

- The JC5 delivers 400W into 8Ω and measured 700W into 4Ω, exceeding its specification and outperforming the McIntosh MC312 (300W both impedances) and Pass Labs X250.8 (250W/500W) at similar or lower cost

www.hifinews.com

www.passlabs.com

. - Its 90A peak current per channel provides exceptional speaker control, particularly valuable for low-impedance or difficult loads

audiobacon.net

. - Dynamic power measurements show 1,680W into 2Ω loads, demonstrating superior transient headroom for complex musical passages

www.hifinews.com

.

2. Class A Bias Range

- Operating in pure Class A up to 12W/channel eliminates crossover distortion at typical listening levels, a design philosophy shared with the Pass Labs X250.8 (~14W) but at a significantly lower price point

audiobacon.net

futureaudiophile.com

.

3. Value Proposition

- At $5,995, the JC5 offers reference-level performance at roughly two-thirds the price of a pair of Parasound JC1 monoblocks ($4,495 each) and significantly less than comparably performing amplifiers from McIntosh or Pass Labs

www.soundstagehifi.com

www.passlabs.com

. - SoundStage! Hi-Ficoncluded: "For $5995, it offers reference-quality sound, and enough power to easily drive any loudspeaker"

www.soundstagehifi.com

.

4. Practical Features

- Per-channel gain controls allow precise system matching and noise optimization—a feature absent on most competitors

audioxpress.com

. - Bridged-mono capability (1,200W @ 8Ω) provides flexibility for bi-amping or driving subwoofers, matching Bryston's approach but at higher power

eqaudio.ca

www.kjwestone.co.uk

. - Loop outputs enable easy bi-amping configurations without external splitters

www.stereotimes.com

.

5. Measured Low-Frequency Extension

- Frequency response measured from 1Hz to 48kHz (±1dB) exceeds most competitors' specifications, beneficial for subsonic content and phase coherence

www.hifinews.com

.

Where the Parasound Halo JC5 Underperforms or Makes Trade-offs

1. Absolute Measurement Precision

- While distortion is very low (0.0015–0.055% across the audioband at 10W/8Ω), it does not reach the extraordinary 0.00016% THD+N figures achieved by the Benchmark AHB2's THX-derived topology

www.hifinews.com

benchmarkmedia.com

. - audioXpressnoted: "The measurements fall short of state of the art, but are still orders of magnitude below audibility"

audioxpress.com

.

2. Weight and Physical Footprint

- At 73 lb, the JC5 is substantial, though lighter than the McIntosh MC312 (~130 lb) and Pass Labs X250.8 (100 lb). However, it is significantly heavier and larger than the ultra-compact Benchmark AHB2 (13.5 lb)

upscaleaudio.com

pt.audio

www.passlabs.com

benchmarkmedia.com

.

3. Channel Matching Precision

- Hi-Fi News measured a slight 0.3dB gain imbalance between channels and minor S/N ratio differences (89.4dB vs. 87.3dB), attributable to the non-precisely dual-mono internal layout—a compromise versus true monoblock designs

www.hifinews.com

.

4. Power Supply Limitations on Mains

- Hi-Fi News noted the 400W/8Ω rating was achieved "by the skin of its transistors" with 240V AC mains; on 120V North American circuits, continuous power into 8Ω may be slightly lower without a dedicated high-current circuit

www.hifinews.com

.

5. Ultra-Low Noise Floor

- While the A-wtd S/N ratio of 115.7dB (re. 400W) is excellent, the Benchmark AHB2 achieves a dynamic range approaching 128.5dB, beneficial for ultra-high-efficiency speakers or extremely quiet listening environments

www.hifinews.com

www.stereophile.com

.

Critical Reception Summary from Recognized Publications

| Publication | Key Assessment | Link |

|---|---|---|

| SoundStage! Hi-Fi | "By any measure, the Halo JC 5 is a superb power amplifier... reference-quality sound, and enough power to easily drive any loudspeaker." | www.soundstagehifi.com (https://www.soundstagehifi.com/inde...1245-parasound-halo-jc5-stereo-mono-amplifier) |

| Hi-Fi News (Lab Report) | "A rugged and low distortion powerhouse that's more than a match for competing sub-£10k heavyweights." | www.hifinews.com (https://www.hifinews.com/content/parasound-halo-jc5-power-amplifier-lab-report) |

| audioXpress | "A very well-engineered 'classic' linear amplifier... could not detect a sonic difference between the JC 5 and two top quality Class D amps." | audioxpress.com (https://audioxpress.com/article/fre...-jc-5-stereo-power-amplifier-the-measurements) |

| Stereotimes | "The best amplifier I've ever listened to in my own home... delivers music in all of its glory and majesty." | www.stereotimes.com (https://www.stereotimes.com/post/parasound-jc5-stereo-amplifier-by-greg-simmons/) |

| Part-Time Audiophile(MC312 comparison) | JC5 matched the MC312's "speaker disappearing act" while delivering more visceral bass impact. | pt.audio (https://pt.audio/2021/07/02/mcintosh-c49-preamplifier-and-mc312-power-amplifier-review/) |

Conclusion

The Parasound Halo JC5 occupies a distinctive position in the high-end amplifier market. It delivers exceptional power, current capability, and Class A refinement at a price point significantly below competitors offering similar performance. While it does not achieve the absolute measurement extremes of specialized designs like the Benchmark AHB2, its performance remains far below audible thresholds and is praised for musicality, dynamics, and system compatibility.

Best suited for: Audiophiles seeking high-power, high-current amplification with Class A refinement for difficult speaker loads, who value practical features (gain controls, bridging) and exceptional value without compromising sonic excellence.

Consider alternatives if: You require ultra-compact size, the absolute lowest possible noise floor for horn/efficiency speakers, or prefer the specific sonic signatures of McIntosh's autoformer topology or Pass Labs' single-ended purity.

All specifications and assessments sourced from independent, recognized audio publications. Measurements reflect laboratory testing under controlled conditions; real-world performance may vary with system configuration and listening environment.

Sist redigert:

Nå refererte jeg heller ikke til dine erfaringer, bare mine egne, men sett i lys av LLM funksjonen. Det enkleste er klart om du vet svaret, men da er heller ikke verdien av å spørre AI like stor. Samtidig stiller jeg kanskje oftest spørsmål knyttet til noe jeg har kunnskap om, men gjerne ønsker å gå dypere. Da skjer det gjerne at jeg oppdager feil eller gjerne at noe er byttet om i den delen som er forholdvis kjent. I slike tilfeller ser jeg ofte at resonnementet og svaret endres etter at dette påpekes. Det betyr selvsagt ikke at den delen av problemstillingen så jeg på forhånd ikke kjente til er riktig beskrevet av AI, men det kan være en gode pekepinn på hva som er riktig. Jeg har for vane å be om vitenskapelige referanser (gitt mitt yrke) og ser at det også hjelper å holde AIen på banen.Jeg skriver egentlig ikke om erfaringer, men om hvordan maskinen fungerer. Du får jo bare "beklager, jeg har tatt feil" fordi du har insistert på at det maskinen spyttet ut ikke var riktig. Det er en direkte respons på det du skriver, sammenstilt med treningsgrunnlaget og en haug med regler som skal passe på at resultatet blir mer spiselig for en menneskelig leser. Det hele er et resultat av sannsynlighetsregning, som det beskrives i lenken fra @weld77 på forrige side.

Den prosessen du beskriver er vel egentlig en måte for deg å komme frem til et svar du på forhånd vet er riktig, eller er klar til å akseptere? Det vil jo ikke fungere om du ikke vet svaret på forhånd, for da har du jo ingen mulighet til å vurdere om den har tatt feil eller om det er riktig at du har et "viktig poeng".

Jeg bruker mest Copilot365 med gpt5, da denne lar meg veksle mellom interne dokumenter og ekstern informasjon.

Jeg har forsøkt 2-3 forskjellige ai mht rør bytte , hender jeg kan sitte med flere varianter men ikke helt husker eller vet hva de kan bidra med

Da får jeg nyttig hjelp synes jeg

Setter f eks 4-5 forskjellige opp mot hverandre og foreslår i hvilke posisjoner jeg få best resultat

Får også henvisning til nett forum butikker og andre kilder

Får også spørsmål tilbake som til tider er ganske geniale

Da får jeg nyttig hjelp synes jeg

Setter f eks 4-5 forskjellige opp mot hverandre og foreslår i hvilke posisjoner jeg få best resultat

Får også henvisning til nett forum butikker og andre kilder

Får også spørsmål tilbake som til tider er ganske geniale

@Alabama

Ikke gi opp å bruke AI. Det er et fantastisk verktøy. Det finnes mange gode - f.eks. GhatGPT, Gemini, Qwen, Grok, Claude, Deepseek

Lær deg å bruke dem, og bli klar over hva de er, og - viktigere - hva de IKKE er.

For å unngå for mye "oppgulp" er et enkelt triks er å bruke ordet "hvorfor" når man spør om noe, samt å be om kilder.

Det er ingen tvil om at AI har hjulpet meg å bli MYE mer effektiv i mange av mine arbeidsoppgaver.

F.eks:

La oss si jeg skal lage noe elektronikk-greier, som består av 10 forskjellige komponenter som skal utføre en jobb.

Før: Jeg måtte finne og lese meg opp på og sammenligne et stort antall varianter av deler for å finne noen som passet. Nå: AI gjør det for meg

Før: Disse 10 delene har fort flere hundre sider med teknisk informasjon jeg måtte sette meg inn i. Nå: Jeg laster opp all denne infoen til AI og be den vurdere hvordan ting passer sammen, og finne svakheter.

Før: Jeg måtte skrive egen kode som tester elektronikken (flere hundre linjer og timesvis med jobb). Nå: AI skriver hele testprogrammet for meg på sekunder.

Men det er utrolig viktig å innse at det er et verktøy på linje med en kalkulator. Shit in = shit out.

Ikke gi opp å bruke AI. Det er et fantastisk verktøy. Det finnes mange gode - f.eks. GhatGPT, Gemini, Qwen, Grok, Claude, Deepseek

Lær deg å bruke dem, og bli klar over hva de er, og - viktigere - hva de IKKE er.

For å unngå for mye "oppgulp" er et enkelt triks er å bruke ordet "hvorfor" når man spør om noe, samt å be om kilder.

Det er ingen tvil om at AI har hjulpet meg å bli MYE mer effektiv i mange av mine arbeidsoppgaver.

F.eks:

La oss si jeg skal lage noe elektronikk-greier, som består av 10 forskjellige komponenter som skal utføre en jobb.

Før: Jeg måtte finne og lese meg opp på og sammenligne et stort antall varianter av deler for å finne noen som passet. Nå: AI gjør det for meg

Før: Disse 10 delene har fort flere hundre sider med teknisk informasjon jeg måtte sette meg inn i. Nå: Jeg laster opp all denne infoen til AI og be den vurdere hvordan ting passer sammen, og finne svakheter.

Før: Jeg måtte skrive egen kode som tester elektronikken (flere hundre linjer og timesvis med jobb). Nå: AI skriver hele testprogrammet for meg på sekunder.

Men det er utrolig viktig å innse at det er et verktøy på linje med en kalkulator. Shit in = shit out.

Ja, det du beskriver er egentlig det jeg prøvde å peke på tidligere.Nå refererte jeg heller ikke til dine erfaringer, bare mine egne, men sett i lys av LLM funksjonen. Det enkleste er klart om du vet svaret, men da er heller ikke verdien av å spørre AI like stor. Samtidig stiller jeg kanskje oftest spørsmål knyttet til noe jeg har kunnskap om, men gjerne ønsker å gå dypere. Da skjer det gjerne at jeg oppdager feil eller gjerne at noe er byttet om i den delen som er forholdvis kjent. I slike tilfeller ser jeg ofte at resonnementet og svaret endres etter at dette påpekes. Det betyr selvsagt ikke at den delen av problemstillingen så jeg på forhånd ikke kjente til er riktig beskrevet av AI, men det kan være en gode pekepinn på hva som er riktig. Jeg har for vane å be om vitenskapelige referanser (gitt mitt yrke) og ser at det også hjelper å holde AIen på banen.

Jeg er ikke så sikker på at det går an å triangulere ved å stille stadig bedre spørsmål til LLMen. Den prosessen er avhengig av at brukeren har kunnskap nok til å stille gode spørsmål, og det kan man bare gjøre når man har kunnskap nok til å observere mangler ved LLMens tekster. Samtidig er den også avhengig av at det fins et "sentrum", et riktig svar å komme frem til. Min påstand er at når LLMer fungerer som de gjør, altså gjennom å absorbere tekst og repetere stil, innhold og språk via mer eller mindre tilgjengelige og forståelige programmeringsforutsetninger, så kan det ikke finnes noe riktig svar hos LLMen. En ender jo opp i et filosofisk spørsmål som handler om hva sannhet og tekst er, og vi kan vel fort bli enige om at et ord ikke har noen essensiell kobling med det ordet betyr. Når en "hest" kan kalles "cheval", "horse" eller "pferd" uten at det er noe galt i det så forstår vi at språk er en form for sosial representasjon av en verden som ikke helt lar seg fange med ord. Dette er selvfølgelig trukket helt ut i det filosofiske, men det er faktisk der vi er når vi lurer på om LLMen gir gode svar eller ikke.

Jeg har absolutt ingen tvil om at metoden din gir deg gode resultater, men jeg tror ikke det er fordi du får LLMen til å endelig fortelle deg det riktige svaret. Jeg tror heller det er fordi du kan så mye at du vet hvilke svar eller hvilke typer svar du kan akseptere som gode. En slags sokratisk metode rettet mot deg sjøl ved hjelp av en maskin. Så er det store problemet at 99% av de som bruker LLMer ikke har den typen innsikt.

Det finnes dedikerte AI og LLM tråder. Denne startet veldig spisset mot hifi og ble plassert under hifi generelt. Usikker på om de skal slås sammen eller at alt utenom hifi flyttes til en av de andre?

Enige, AI er kommet for å bli…ut i fra det som fremkommer har AI en utfordring som mange ikke tenker på/er klar over, og det handler om kvaliteten på kilde informasjonen den bygger på. Språkmodeller og andre AI-systemer er i stor grad avhengige av store mengder eksisterende tekst fra internett for å lære mønstre og produsere svar. Problemet er at en stadig større del av innholdet på nettet allerede er generert av AI. Enkelte anslag peker på at rundt 20 % av informasjonen som finnes via søk og nettsider i dag kan være AI-generert, og denne andelen er økende.@Alabama

Ikke gi opp å bruke AI. Det er et fantastisk verktøy. Det finnes mange gode - f.eks. GhatGPT, Gemini, Qwen, Grok, Claude, Deepseek

Lær deg å bruke dem, og bli klar over hva de er, og - viktigere - hva de IKKE er.

For å unngå for mye "oppgulp" er et enkelt triks er å bruke ordet "hvorfor" når man spør om noe, samt å be om kilder.

Det er ingen tvil om at AI har hjulpet meg å bli MYE mer effektiv i mange av mine arbeidsoppgaver.

F.eks:

La oss si jeg skal lage noe elektronikk-greier, som består av 10 forskjellige komponenter som skal utføre en jobb.

Før: Jeg måtte finne og lese meg opp på og sammenligne et stort antall varianter av deler for å finne noen som passet. Nå: AI gjør det for meg

Før: Disse 10 delene har fort flere hundre sider med teknisk informasjon jeg måtte sette meg inn i. Nå: Jeg laster opp all denne infoen til AI og be den vurdere hvordan ting passer sammen, og finne svakheter.

Før: Jeg måtte skrive egen kode som tester elektronikken (flere hundre linjer og timesvis med jobb). Nå: AI skriver hele testprogrammet for meg på sekunder.

Men det er utrolig viktig å innse at det er et verktøy på linje med en kalkulator. Shit in = shit out.

Dette skaper en spesiell utfordring over tid. Når ny AI trenes eller genererer tekst, kan den komme til å bruke materiale som allerede er skrevet av andre AI-systemer. Dermed oppstår en slags sirkulær prosess der AI i praksis bygger videre på tidligere AI-generert informasjon, i stedet for direkte på originale kilder som forskning, førstehåndsdata eller menneskelig fagkompetanse.

Konsekvensen kan bli det man kan beskrive som en «tåkeeffekt». Informasjonen blir lag på lag med gjengivelser, omskrivinger og oppsummeringer av tidligere innhold. Etter hvert kan det bli vanskeligere å spore hvor informasjonen opprinnelig kommer fra. Originalkilder kan bli borte i prosessen, og det kan føre til at innhold gradvis mister presisjon, nyanser og etterprøvbarhet.

Når slike lag bygger seg opp over tid, kan resultatet bli en form for «utvanning» av kunnskap. Informasjonen kan fortsatt virke plausibel og godt formulert, men den kan være basert på tidligere fortolkninger i stedet for direkte kilder. Derfor blir kildekritikk, dokumenterte referanser og tilgang til originale data stadig viktigere i en tid der stadig mer innhold produseres automatisk.

Kutt ut ChatGPT! Skjerp dere!!

www.aftenposten.no

www.aftenposten.no

Debatt: Avslutt ChatGPT. Abonnementet ditt finansierer autoritarisme.

Som historiker har jeg studert historiens største forbrukerboikotter, og ChatGPT er et perfekt mål. Vi kan ta det ned – og sende et kraftig signal til Silicon Valley: Dere kan være de neste.

Jeg kastet ut ChatGPU i en vinter/vår-rengjøring der målet er å kvitte meg med US big tech. Le Chat bruker jeg mye til feilsøking på PC, nettverk og servere. Min Linux PC har en bande med fonter som jeg tenkte var unyttige. Jeg spurte Le Chat om hvilke jeg kunne avinstallere, og fulgte forslaget ukritisk, men skeptisk. Etter dette har jeg brukt 3 stive timer på å gjenopplive PC-en.  . Så nå blir det medarbeidersamtale i morra.

. Så nå blir det medarbeidersamtale i morra.

KI kommer til å endre mye. Men først tar vi en krasj i US AI aksjer, og mengder med rimelige grafikkort på brukten.

KI kommer til å endre mye. Men først tar vi en krasj i US AI aksjer, og mengder med rimelige grafikkort på brukten.

- Ble medlem

- 26.02.2013

- Innlegg

- 5.417

- Antall liker

- 5.586

Flere "gode" argumenter her for hvordan og hvorfor OpenAI kan snuble inn i fremtiden. Og faktum at tRump nå har "tatt i dem", - dere vet mannen som ødelegger alt han tar i gjør det kanskje ikke bedre

For ordens skyld. Stol ikke blindt på AI. Her et praktisk eksempel…