OK Open Baffle & Horn & Kasse & Kaffeslaberas

- Trådstarter oks81

- Startdato

Diskusjonstråd Se tråd i gallerivisning

-

bra jobba, oks.Vis vedlegget 581325

Da er vi oppe å gå med DEQX sin FIR korreksjon og treveis aktiv deling med faselinjære filtre

tøff som juling, de hønna.

Det er ikke slik at FIR er "det nye" og IIR er "det gamle". Begge nevnes for eksempel i boken Theory and application of digital signal processing fra 1975. Disse to typene filtre har helt ulike måter å jobbe på, og det er ikke slik at den ene har alle fordelene til den andre, pluss mye mer.Takk for svar, jeg spurte mest av nysjerrighet siden jeg ikke kjenner produktet så godt. Sitter på en groundsound i dag, og den får gjøre jobben en stund til, det er vel noe i samme gaten som DEQX kanskje, men enda litt mer "gammeldags" da den ikke har FIR. Brukes kun til deling, nivå og delay, med noen få PEQ i bassen pr kanal.

I prinsippet trenger man en ekstremt liten prosessor for å håndtere det nødvendigste innen korreksjon dersom datainnsamlingen er god nok. Imidlertid forenkler det ett og annet når man har tilgang på mer prosessorkraft. For eksempel ville det være praktisk om man kunne jobbe med en del elementer i korreksjonssystemet helt uavhengig av hverandre, uten at man får treg responstid, og uten at man risikerer at den ene får den andre til å feile. Har man for eksempel behov for 8000 taps pr kanal, og en DSP skal håndtere 2 kanaler vil man med en Sigma 1451/52 ha konsumert ca 2/3 av regnekraften. Man har da potensielt tilgang på rundt omkring 1000 biquads, altså IIR-filtre i tillegg. Det betyr i prinsippet at man har en stor FIR-blokk pr kanal og i praksis ubegrenset med IIR-filtre.

Som et praktisk eksempel kan vi se for oss at vi korrigerer høyttalerne med et FIR-filter (slik som DEQX gjør). Så gjør man en romanalyse og slår fast at rommet har relativt mye etterklang ved høye frekvenser. Vi kan da få prosessoren til å sette et veldig forsiktig EQ-punkt som demper et bredt område i øvre mellomtone/nedre diskant for å kompensere for dette. Dette krever i seg selv ikke mer enn ett punkt, men dette er altså et eksempel. Vi kan tenke oss at man er fornøyd med høyttalerkorreksjonen, men synes kompensasjonen for romklangen går en smule hardt til verks. Da endrer man bare dette EQ-punktet.

Så kan vi tenke oss at man bytter sofagruppe. Dette påvirker lyden en anelse, men på ingen måte har det endret impulsresponsen til høyttalerne. Man kan da kanskje ønske seg å dempe toppen en anelse. For å slå fast effekten av dette vil man kanskje ønske å gjøre en måling. Man kan da måle med FIR-filteret inkludert, men uten dette EQ-punktet som kompenserer for klangen i rommet.

Dersom de to var en del av det samme FIR-filteret må man endre FIR-filen. En DSP responderer veldig mye raskere på en endring av en parameter, for eksempel gain for et EQ-punkt. I tillegg må man, for å måle rommet på nytt uten den tidligere romkompensasjone, men med høyttalerkalibreringen, måtte endre FIR-filteret til å ikke gjøre noe med frekvensresponsen i rommet før man kan gjennomføre målingen, eller man må ta hensyn til den målingen i prosessen. Man må da ha tilgang på filene som fikset dette i utgangspunktet.

Så finnes det noen tekniske fordeler og ulemper med hvordan de begge håndterer signaler, og hva slags datainnsamling som er best egnet for å generere ulike typer filtre automatisk.

Du gir vel snart opp denne boksen også, og da blir det full FIR i peisenOm jeg FIRer nedpå Linjærakevitt så går det ikke lange tiden før er helt i FIR og flamme!!

Blir det for mye dog så sovner en bare. Den som sover FIRer ikke!!

Nei, FIR all del, den er alt FIR god til å kastes, så den FIR nok stå i benken og gjøre jobben sin

Du gir vel snart opp denne boksen også, og da blir det full FIR i peisenOm jeg FIRer nedpå Linjærakevitt så går det ikke lange tiden før er helt i FIR og flamme!!

Blir det for mye dog så sovner en bare. Den som sover FIRer ikke!!

Liker den kjempegodt!Det som Snickers er litt inne på er at vi må og skille dette med signalprosess og produkt.

Som forbrukere blir vi hele gjengen veldig opptatt av produkt.

Jeg er ikke flink med digitalteknikk, og sliter veldig med forståelse av biquads, taps osv.

Må bare se overordnet på det.

Det som vi ser på produktene er at straks en entrer FIR basert så benytter en automatisk oppsett.

Mens det meste IIR basert er manuelt.

Om jeg har forstått ting riktig så er det ikke noe problem å lage automatisk IIR basert for høyttalerkorreksjon som fint holder følge med FIR basert?

Arrest me if I`m wrong

Med manuel IIR så står en med hele datasamlingen selv, og en skal overføre dette og sette i DSP.

Dette setter krav til brukeren.

Selv når har benyttet IIR så har bare måttet se grovt på hele greia og bare kjøre delinger, delay og veldig enkel EQ for voicing.

Så dårlig er jeg på dette

For dem som evt er interressert så fant jeg denne filmsnutten på youtube, som enkelt forklarer hovedessensen i hvordan en setter opp FIR filtrene i DEQX.

For voicing etterpå, siden frekvensresponsen blir flat etter FIR høyttalerkorreksjon, så benytter en EQ.

Jeg ender opp med en god del fall fra 1k og opp til 20k da har et noe livlig rom.

Jeg har ikke komt til å gjøre rom målinger enda for å se hva som henger igjen. Og så har jeg et rimelig avslappet forhold til det

Jeg spurte Snickers på pm her en dag, når en banker løst med FIR på denne måten, hvordan er det da med f.eks intermodulasjonsvreng i driver?

Jeg fikk da til svar at i mange tilfeller så går vreng ned etter korreksjon.

Mitt hue sa da i utgangspunktet at når en korrigerer så "tvinger" en drivere til noe som ikke er i dems natur.

Men det er ikke tilfelle. En må se dette på en annen måte.

Jeg klarer ikke helt gjenforklare, vi er over på signalprosess, men ville skrive dette så en ikke ser på korreksjon som noe som tvinger høyttalere til å gjøre noe dem ikke er ment til. Da har man i tilfelle gjort noe galt.

En tap er et korreksjonspunkt i tidsdomenet. Når et audiosample mates inn i et FIR-filter korrigeres det først i tap nr 1. Så sendes sample 1 til tap nr 2, og sample nr 2 sendes til tap nr 1. Sånn jobber alle samplene seg gjennom alle taps i filteret inntil man har kommet til siste tap. Etter dette forkastes det første sampelet slik at filteret har en absolut definert lengde. Filteret har da samme samplingfrekvens som selve audiosignalet.Jeg er ikke flink med digitalteknikk, og sliter veldig med forståelse av biquads, taps osv.

Må bare se overordnet på det.

Et eksempel kan være med 4 taps. De tre første taps er lik null, og den siste er lik en. Hvert sample går da til tap 1, 2 og 3, men ingen ting kommer ut fordi disse taps er bare null. Fjerde tap er lik 1, og der går alle audiosamples rett gjennom. Dette filteret er kort og godt et 4 sample langt delayfilter som ikke endrer noe på signalet forøvrig.

Det er lett å henge seg opp i at FIR-filtre korrigerer impulsrespons. Men impulsrespons, frekvensrespons og fase er alltid knyttet sammen. Det betyr at både FIR og IIR-filtre korrigerer både impulsrespons og frekvensrespons. Allikevel jobber de fundamentalt forskjellig.

Det er spesielt to ting man kan tenke på som kjennetegner et FIR-filter. Det ene er at FIR-filteret ikke har noen feedback. Det som skjer i tap nr 2 har ingen sammenheng med det som skjedde i tap nr 2 annet enn den sammenhengen som følger av målingen man la til grunn. Den andre tingen er at antallet taps er definert. Med andre ord lengden på filteret er absolutt definert, filteret har en "finite" varighet.

En analogi til et FIR-filter kan være som følger:

Vi kan tenke oss en lydfil som varer i 1 sekund. Vi kan tenke oss at fila består av 48 000 samples. Dette er målingen vår. Selve lydfilen er det vi spilte inn via målemikrofonen.

Så kan vi tenke oss en virtuell lydfil. Denne har også en varighet på 1 sekund. Denne fila er idealet vårt. Den inneholder en optimalisert impulsrespons, men den har også begrensninger i båndbredde (vi ønsker for eksempel ikke å tvinge høyttalerne til å spille med fullt nivå ved 100kHz, eller ved 2Hz). Har vi for eksempel aktiv deling inneholder den også filterflankene for hver driver, og den inneholder selvsagt target frekvensrespons.

Så regner vi ut forskjellen på idealet og det vi har målt. Både idealet og det vi har målt består av 48 000 datapunkter i tidsdomenet. Det betyr at vi får en numerisk verdi som forskjell for hvert sample. Disse numeriske verdiene, 48 000 stk, er i prinsippet FIR-filteret vårt.

Dersom vi for eksempel skulle hatt et filter på 24 000 taps korter vi ned både referansen og selve lydfila (målingen) til 0,5 sekunder. Det som eventuelt måtte skje etter 0,5 sekunder er ikke en del av målingen, og det blir heller ikke korrigert.

Et IIR-filter likner mer på et tradisjonelt analogt filter. Slike filtre kan ha veldig mange ulike utforminger, men felles for dem er at de kan defineres innenfor det samme settet parametre. Det betyr at man egentlig har samme grunnutforming på disse filtrene, men ved å endre på enkeltparametre får man dem til å opptre som for eksempel høypass, lavpass, shelf, EQ osv. Denne grunnutformingen kalles en biquad, og i praktisk bruk kan man på en måte se en biquad som en "plass" for et EQ-punkt, et delefilter eller liknende. Opprinnelsen til biquads er egentlig en måte å bygge opp et analogt filter på.

Noen av parametrene i en biquad befinner seg i en feedback loop. Det er fullt mulig å definere parametrene i en biquad slik at man får et ustabilt filter. Et slikt filter vil kunne gå i selvsving og vil ha uendelig varighet. En stabil biquad vil klinge ut, og hvor lang tid dette tar avhenger av Q, signalet inn, og hvor høy presisjon filteret har. Et 64 bits filter med høy Q vil ha en enorm etterklangstid, mens et tilsvarende filter med lav Q vil dø ut svært raskt. Parametrene man setter i én biquad har ingen påvirkning på parametrene man setter i en annen biquad, så disse deler i prinsippet ikke noe annet enn samplefrekvens. Denne udefinerte tidskarakteristikken gjør at man kaller dette for "infinite".

En biquad behandler også hvert audiosample, men til forskjell fra FIR-filtre som kun bearbeider ett og ett sample, og summerer det som kommer ut, vil et IIR-filter bearbeide ett sample, kjøre det i feedback, mikse det med neste sample, bearbeide de to på nytt, kjøre dem i feedback osv. Litt på samme måte som et aktivt filter i feedbackloopen på en op-amp.

Dessverre tror jeg man kan forklare dette veldig mange ganger, men for hver gang vil det være et fåtall som får noe særlig ut av det.

For å generere et FIR-filter er man avhengig av data å mate inn i systemet. Man kan tenke seg at man har en target og en måling som er helt like. Da vil ikke det resulterende filteret gjøre noe som helst. Så kan vi se for oss at target modifiseres ved at man endrer frekvensresponsen slik et EQ-punkt ville gjort. Da vil forskjellen på målingen og target tilsvare dette, og vi har laget oss en FIR-basert parametrisk EQ. Denne styres da manuelt, og man bruker ikke en faktisk måling for å generere dette filteret.Det som vi ser på produktene er at straks en entrer FIR basert så benytter en automatisk oppsett.

Mens det meste IIR basert er manuelt.

Vi kan også se for oss at vi lager et automatisert filter for IIR-korreksjon. Men dette vil likne mer på en manuell prosess. Man må identifisere hvert avvik og ha regler for å bestemme hvordan man genererer EQ-punkter for å behandle disse.

Det finnes en del avvik i høyttalere som det er vanskelig å gjøre noe med når man bruker IIR-filteret. Det finnes også noen det er vanskelig å gjøre noe med når man bruker FIR-filtere. Når man korrigerer med IIR-filtere vil man altså kunne gå glipp av noe, men det er få eller ingen ting man gjør med IIR-filtere som korrigerer noe som opptrer annerledes i andre situasjoner. Risikoen for dette er noe større med FIR-filtere. Eksempler på dette er dynamisk flux i magnetsystemer. Et FIR-filter vil kompensere for dette, mens et IIR-filter vil ikke gjøre noe med dette. Når dette endrer seg med signalpåtrykk vil IIR-filteret fortsatt ikke gjøre noe, mens FIR-filteret vil nå korrigere feil. Dette til tross for at for et gitt signal er dette pr definisjon minimum fase.Om jeg har forstått ting riktig så er det ikke noe problem å lage automatisk IIR basert for høyttalerkorreksjon som fint holder følge med FIR basert?

Arrest me if I`m wrong

Man kan også se for seg at en driver komprimerer signalet noe. Ved signalet 0,5 inn gir den 0,5 ut. 0,7 inn gir 0,7 ut, mens 0,8 inn gir 0,75 ut, 0,9 inn gir 0,8 ut osv. Man får en komprimeringseffekt når signalet går over et visst nivå. Dersom målingen er gjort ved høyt nok nivå vil FIR-filteret ha dette som en del av korreksjonen enten man vil eller ikke. Siden volumekontrollen som regel er plassert etter filteret vil den korrigere for dette også når man spiller på et nivå som er langt unna å trigge denne effekten. Den totale forvrengningen vil da øke, mens ved en gitt volumeinnstilling vil den bli svært lav.

Man kan plassere volumekontrollen før et slikt filter. Man kan også lage et slikt filter som ikke er FIR-basert, og man kan helt fint lage en separat funksjon som tar seg av det dynamiske, plassere denne etter volumekontrollen, og plassere EQ før volumekontrollen.

Normalt er det dette som er situasjonen, men som beskrevet over kan man altså automatisere også dette. DEQX har prøvd seg på dette, men svært begrenset hell. Selv på den gamle 8024 digital-EQ-en til Behringer har man en slik funksjon. Men det låter redselsfullt.Med manuel IIR så står en med hele datasamlingen selv, og en skal overføre dette og sette i DSP.

Dette setter krav til brukeren.

Det er ikke et dumt utgangspunkt i det heletatt. Verden har sett mange gode høyttalere opp gjennom historien der nettopp dette er selve metodikken som ligger til grunn.Selv når har benyttet IIR så har bare måttet se grovt på hele greia og bare kjøre delinger, delay og veldig enkel EQ for voicing.

Så dårlig er jeg på dette

Det jeg skrev over om signal inn vs signal ut, der vi har en ulinjær effekt, kan vi også betrakte med to samtidige signaler.Jeg spurte Snickers på pm her en dag, når en banker løst med FIR på denne måten, hvordan er det da med f.eks intermodulasjonsvreng i driver?

Jeg fikk da til svar at i mange tilfeller så går vreng ned etter korreksjon.

Mitt hue sa da i utgangspunktet at når en korrigerer så "tvinger" en drivere til noe som ikke er i dems natur.

Men det er ikke tilfelle. En må se dette på en annen måte.

Jeg klarer ikke helt gjenforklare, vi er over på signalprosess, men ville skrive dette så en ikke ser på korreksjon som noe som tvinger høyttalere til å gjøre noe dem ikke er ment til. Da har man i tilfelle gjort noe galt.

1: Vi har et signal med en gitt frekvens. Det har en amplitude på 0,1.

2: Vi har et signal med en gitt frekvens, det har en amplitude på 0,8

Når vi spiller av signal nr 1 vil vi få 0,1 ut.

Når vi spiller av signal nr 2 og nr 1 samtidig vil amplituden på signal nr 2 bringe oss opp i området med komprimering. Da vil amplituden på signal nr 1 gå ned fra 0,1 til 0,05. Straks amplituden på signal nr 2 går ned vil amplituden på signal nr 1 gjenopprettes til 0,1, men så beveger signal nr 2 seg ned på minussiden, og over i det ulinjære området. Da går igjen amplituden på signal nr 1 ned til 0,5. Det er også viktig å huske på at begge disse signalene modulerer hverandre.

Denne typen modulering kaller vi intermodulering. Dersom vi retter opp overføringsfunksjonen slik at signaler helt opp til 1.0 gjengis som 1.0 vil vi unngå denne moduleringen. Men i en driver er ikke nødvendigvis denne moduleringen konstant, og en korreksjon som er perfekt i ett tilfelle kan virke mot sin hensikt i et annet tilfelle. Her er det med andre ord viktig å vite hva en kompensere for, og hva en bør la være å gjøre noe med.Flott innlegg, kan en se tilbake på når en glemmer!

Alt virker logisk det jeg klarer å tolke.

Et fenomen jeg finner interressant!

Etter montert inn DEQX så låter dette bedre enn med passive filtre.

Og en kjører det jeg vil si ganske heftig korreksjon med DEQX i forhold til hva en klarer passivt.

Utrolig hvor godt en hører at det fortsatt er mine høyttalere, signaturen til 2360, signaturen til diskantene.

Så også i forhold til romklang, en summerer sammen energien med direktelyd, og man oppfatter nivået.

Likevel forholder man seg veldig til høyttalernes egenlyd og hva som foregår direkte.

Får man en del folk på besøk så er jo dette absorbenter i seg selv, en hører godt hvordan energien detter oppover i frekvens.

Likevel hører man godt høyttalernes signatur og egenklang.NNæss

Gjest

Vet ikke om det var spesifikt til meg, eller generelt til alle. Eventuelt er det mulig jeg fremstår som litt dummere en jeg egentlig er

Det er ikke slik at FIR er "det nye" og IIR er "det gamle". Begge nevnes for eksempel i boken Theory and application of digital signal processing fra 1975. Disse to typene filtre har helt ulike måter å jobbe på, og det er ikke slik at den ene har alle fordelene til den andre, pluss mye mer.Takk for svar, jeg spurte mest av nysjerrighet siden jeg ikke kjenner produktet så godt. Sitter på en groundsound i dag, og den får gjøre jobben en stund til, det er vel noe i samme gaten som DEQX kanskje, men enda litt mer "gammeldags" da den ikke har FIR. Brukes kun til deling, nivå og delay, med noen få PEQ i bassen pr kanal.Fikk innføring i FIR og IIR når jeg startet å studere på slutten av 90-tallet, og ble gjort kjent med pros and cons.

Ellers, takk for masse bra info.

Etter å ha brukt Groundsound en god del år, og etter å ha hatt en kort affære på ett par måneder med audiolense sist vår, så er holdningen min at dette er vanvittig kjekke verktøy (begge deler). Spesielt når en driver å bygger høyttalersystemer selv, men det kan være ting å hente i ett vanlig stueanlegg også. Men minst mulig bruk av DSP, dsv at prosessoren jobber minst mulig, er fremdeles min enkle filosofi basert på de få årene med erfaring jeg har fått med det. Og jeg antar at det er uavhengig av hva boksen med prosessoren heter og hvordan boksen ser ut.Min enkle miniDSP 2x4 som vel koster det samme som en kasse brus, går helt i metning om en kjører på med PEQs. Det låter bøtte.

Hvordan GS er og hva prosessor som er i den veit jeg ikke.

Men jeg finner det rart om et så flott produkt ikke tåler det den er skapt for.

Korreksjonsmessig trur jeg det er lett å gå i fella og gjøre ting man ikke bør røre så mye, samtidig ikke se hva helt hva som trenger mer oppmerksomhet.

Dette går også på hvor flink vi er å måle.

Det kan fort være greit se grovt på tingene, korrigere minst mulig, kjøre enkle delefiltre, korrigere delay og det skal låte bra, bruke en del tid på voicing.

Fikk en liten aha opplevelse da prøvde etter Snickers oppskrift å kjøre EQ med å se på Group Delay for å korrigere det på horn.

Men fikk ikke hørt resultatet da miniDSPen gikk i metning.

Etter korrigert GD kjører en ellers EQ med lav Q for å korrigere frekvensrespons.

Det kan kanskje prøves?NNæss

Gjest

Mener du å ikke bruke PEQ der hvor det er minimum fase issues (eller hvordan det nå var, husker ikke sikkert)? Anyways, for min del har jeg ikke "skrudd lyd" siden juli sist sommer, og har ikke noen store planer i nær fremtid hellerMin enkle miniDSP 2x4 som vel koster det samme som en kasse brus, går helt i metning om en kjører på med PEQs. Det låter bøtte.

Hvordan GS er og hva prosessor som er i den veit jeg ikke.

Men jeg finner det rart om et så flott produkt ikke tåler det den er skapt for.

Korreksjonsmessig trur jeg det er lett å gå i fella og gjøre ting man ikke bør røre så mye, samtidig ikke se hva helt hva som trenger mer oppmerksomhet.

Dette går også på hvor flink vi er å måle.

Det kan fort være greit se grovt på tingene, korrigere minst mulig, kjøre enkle delefiltre, korrigere delay og det skal låte bra, bruke en del tid på voicing.

Fikk en liten aha opplevelse da prøvde etter Snickers oppskrift å kjøre EQ med å se på Group Delay for å korrigere det på horn.

Men fikk ikke hørt resultatet da miniDSPen gikk i metning.

Etter korrigert GD kjører en ellers EQ med lav Q for å korrigere frekvensrespons.

Det kan kanskje prøves?Bruker kun en PEQ med lav Q på Raal Lazy for å flate ut den oppadgående responsen med topp på 14kHz, også kjøres det 2-3 PEQ på hver SLOB. Ellers så er det ikke behov i mellomtone og midbass, i mine ører i hvert fall fwiw

NNæss

Gjest

Får se hva fremtiden bringer, som du selv skriver "hvorfor fikse noe som funker"En ser på Group Delay istedenfor frekvensrespons.

Men ikke sikkert det er nødvendig, jeg veit ikke

Følger med på hva du gjør her og litt ellers på hfs tenker jeg, og plukker opp litt ting og tang til når jeg finner ut at jeg skal gjøre noe nytt i eget oppsett en gang i fremtiden.

Blir du å se på messa i år da? Er vel lenge siden nåMed tanke på størrelsen på den messa er den vel så vidt innenfor helsemyndighetenes anbefalinger.

Sent fra min SM-G965F via TapatalkNNæss

Gjest

Ja pokker, jeg har vist et poeng der, er det bra så la det være

Messe hadde vert kult igjen! Juging og dekksparking! Kjekt å treffes slik! Men det ser jo litt skummelt ut i år....

Ja det kan jo se litt skummelt ut, men hvem vet hvordan ståa er til høsten. Frem til det kommer en annen beskjed, så tar i hvertfall jeg høyde for å stille opp.Med tanke på størrelsen på den messa er den vel så vidt innenfor helsemyndighetenes anbefalinger.

Sent fra min SM-G965F via Tapatalk

Er hyggelig å sparke litt dekk og juge innimellom, er ikke så mange arrangementer og muligheter vi har for detDet blir ikke lov med intimslåssing i år, den ordinære kampen mot kabelmafiaen skal utføres med avstandslåssing, med kjepper på minimum 2 meter

Men du har rett, det er en fin arena for å treffe medpassienter.

Jeg er tonedøv, hører ikke forskjell på anlegg, så det blir mest med øl og juging, så da er det kjekt med kjentfolk å ta en øl og juge med!

Keep up the good work Næss!!

Er det JMLC og GPA enda?

Kabelmafiaen får ta det ut på forumet, sittende 2m unna hverandre i Horten.Det blir ikke lov med intimslåssing i år, den ordinære kampen mot kabelmafiaen skal utføres med avstandslåssing, med kjepper på minimum 2 meterDEQX sin autokorreksjon og OB fjølene går ikke bra sammen.

Jeg trur dette har med at OBene sender ut lyd både bak og fremme, over dipolpeak blir dette kaos.

Men jeg er ikke helt sikkerjeg trur det er slik.

Jeg traff godt tidlig med korreksjon nr.2.

Det var egentlig flaks, autokorreksjon jobber da ned til 400hz, deling 500hz med 96dB steilhet.

Deling havner da i en dipp på fra OBene og den boostes dermed ikke.

Andre delefrekvenser og det går ikke så bra, evt må øke deling en god del og følge etter med korreksjon.

Deling oppe mott diskant drar for med seg noen bølger, men begrenser korreksjonsvinduet her.

Usikker på hva som foregår.

Måling er gjort i 1 punkt 2m fra høyre høyttaler. Så benytter en samme korreksjon på begge høyttalere.

Siden det allerede låter bra, så blir evt. videre forskning på dette bare for å finne ut hvordan ting funker.

Får se hvor mye tid orker bruke på det.NNæss

Gjest

Ja det er nettopp det, treffe folk og preike og lyve, og øl...Det blir ikke lov med intimslåssing i år, den ordinære kampen mot kabelmafiaen skal utføres med avstandslåssing, med kjepper på minimum 2 meter

Men du har rett, det er en fin arena for å treffe medpassienter.

Jeg er tonedøv, hører ikke forskjell på anlegg, så det blir mest med øl og juging, så da er det kjekt med kjentfolk å ta en øl og juge med!

Keep up the good work Næss!!

Er det JMLC og GPA enda?Jeg bryr meg vanligvis lite om denne slåssingen, uansett øl eller ikke i kroppen, man kommer uansett aldri til å finne en universell sannhet (eller enighet) når det kommer til lyd og veien frem, og det er heller ikke viktig imho ;D

Sverger til JMLC og GPA i mellomtonen, og SLOB med GPA. Ser fremdeles på SLOB som en av de beste investeringene jeg har gjort, etter mine preferanser, de står stødig og trygt her

Endte opp med ett par Biradial 1,4" fra Autotech sist høst, men har ikke fått ræva i gir og testet de enda... får se en vakker dag, de ligger bra der de ligger, tørt og trygt.

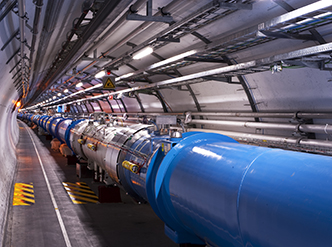

Følger med på veien din fremover, syntes det er kult du gjorde investeringen i DEQX. Spennende når du har fått brukt litt tid med den, å høre hvordan du syntes det funker i forhold til rent analogt som du vel har mest erfaring med.Nå som snøen har gått blir det tid til å pusle med andre ting, håper å få ferdig min nye partikkelakselerator i sommer

Build your own particle accelerator

The world’s largest particle accelerator, the LHC, is deepening our understanding of what happened just after the Big Bang. Here’s how to explore the principles of a particle accelerator in your classroom.www.scienceinschool.org

Det blir nok dødsbra! Men før du begynner å mekke for mye selv kan det være lurt å sjekke om det er ting som dekkes av garantien.Ringte og snakket med verksmesteren på verksted hos Dødsstjerne forhandleren i Førde.

Han bekreftet nok at garantien var gått ut. Han virket noe stresset og hadde noe pusteproblemer. Travle dager på verkstedet.

Men fikk noen gode tips om som hjelper med reperasjonen.Jaha, noen som har gått feil? Hvordan er det å integrere TAD TD4002 ?

Hvordan er det å integrere TAD TD4002 ? -

Laster inn…

Diskusjonstråd Se tråd i gallerivisning

-

-

Laster inn…