Det blir garantert snarveier. AI trenger ikke være bra, bare bra nok til at man kan spare utgifter effektivt nok til å utkonkurrere prekariatet i samfunnet.Jeg skjønte selvsagt at det var en illustrasjon, og at ikke det hele henger på om paven får tre eller åtte bein. Poenget mitt er vel bare at jeg syns det ser ut som utviklingen allerede går så rasende fort at jeg tror innvendingene om feil bare er for barnesykdommer å regne. Særlig hvis det er sterke kapitalkrefter bak som pusher mot å få lansert diverse pengebesparende løsninger eller ting som vil gi ren profitt, da vil man kanskje til og med ta noen snarveier, ref. de selvkjørende bilene til Musk.

Diverse OpenAI - sjukt imponerende AI

- Trådstarter SigbergAudio

- Startdato

Diskusjonstråd Se tråd i gallerivisning

-

- Ble medlem

- 26.02.2013

- Innlegg

- 5.455

- Antall liker

- 5.646

Om det blir like bra som denne karen som forsøker lage musikk med hjerneaktivitet er det vel en stykke igjen for begge teknologieneKva skjer når AI nytter denne?

Oppsiktsvekkende studie: Forskere har lagd et verktøy som kan lese tanker

Verktøyet kan forstå hva folk tenker bare ved å tolke målinger av hjerneaktivitet. – Spennende og skremmende, mener norsk professor. forskning.no

forskning.no

HHardingfele

Gjest

Mitt innlegg handlet om at man får det man spør om, meget hurtig. Så handler det om i hvilken utstrekning man er i stand til å vurdere hva man har fått og å raffinere det, med ytterligere prompts."Code interpreter" var jo ikke så veldig imponerende. Grunnleggende stat funksjoner (gruppering og telling) basert på en csv-file.

Mange ungdomsskoleelever vil greie det samme vha av excel/pivot innen samme tidsramme.

Det vi ser er meget hurtig bearbeiding av opplysninger, men det man bør legge merke til, er at AIen setter opp brede og detaljerte parametre utfra en veldig enkel prompt. (Like what an executive would ask for, sier en av dem). Make this data understandable ...

Dess mer detaljert prompt, jo mer presist blir resultatet. (Bl.a. - remove one of the pope's legs. Eller - add a third leg to the pope).

Jeg ser et enormt potensial i AI til å tråle "all" kunnskap lynkjapt, noe som idag er umulig for et menneske, og å evaluere denne, før videre bearbeiding.

Innen akademia, for eksempel, har man nå gravd seg ned i separate felt, med ytterligere inndelinger, og doktorgradene handler om minima, uten maxima sammenføyning eller overblikk. Nå brukes AI for å se på synergimuligheter mellom ulike felt, spesielt innen kjemi, materialkunnskap, o.a. på spennede vis.

Som dette:

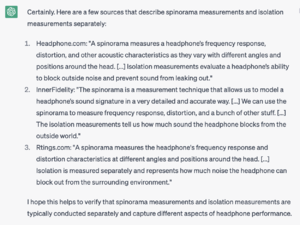

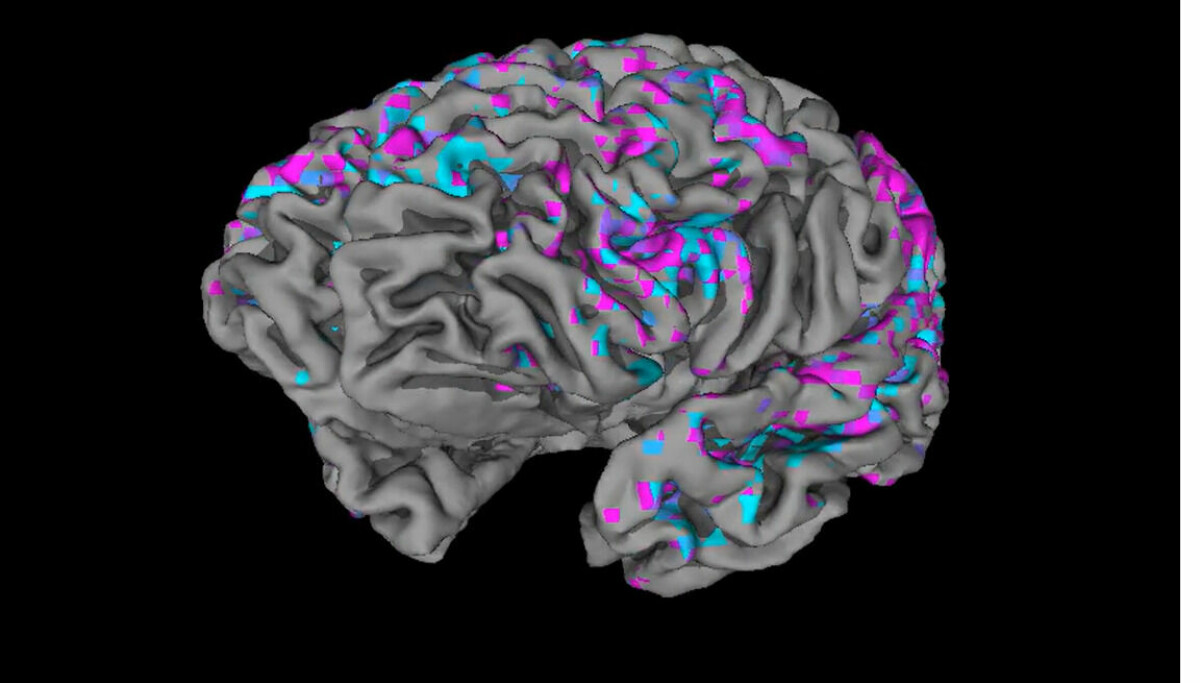

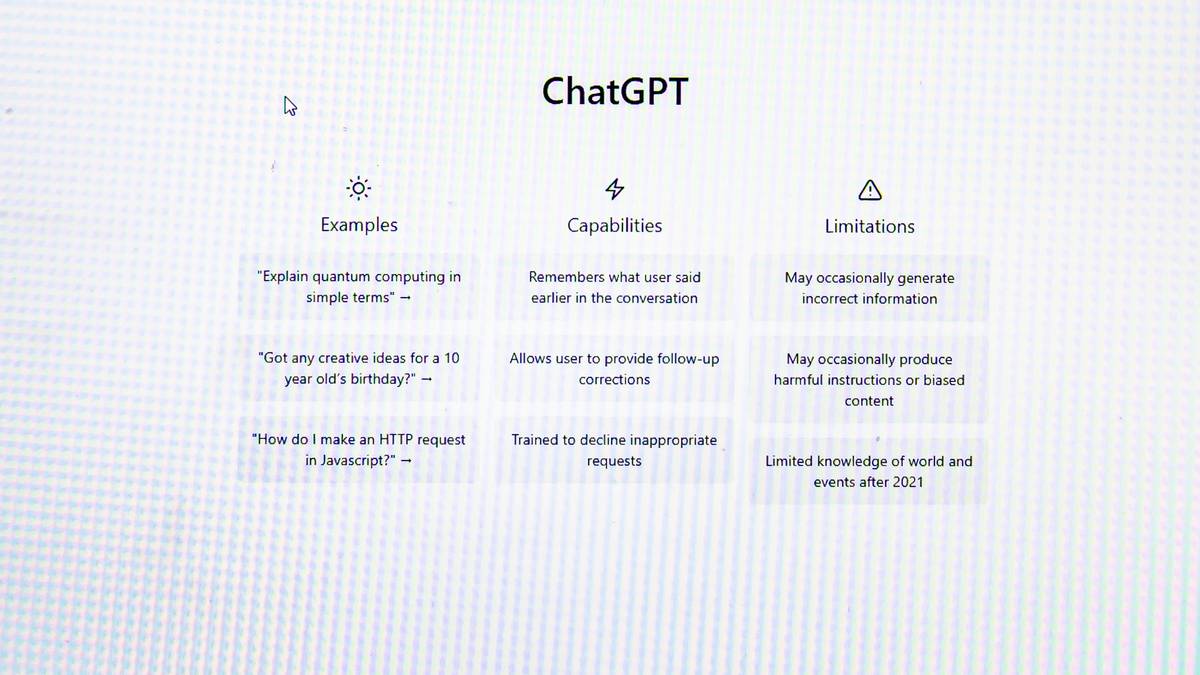

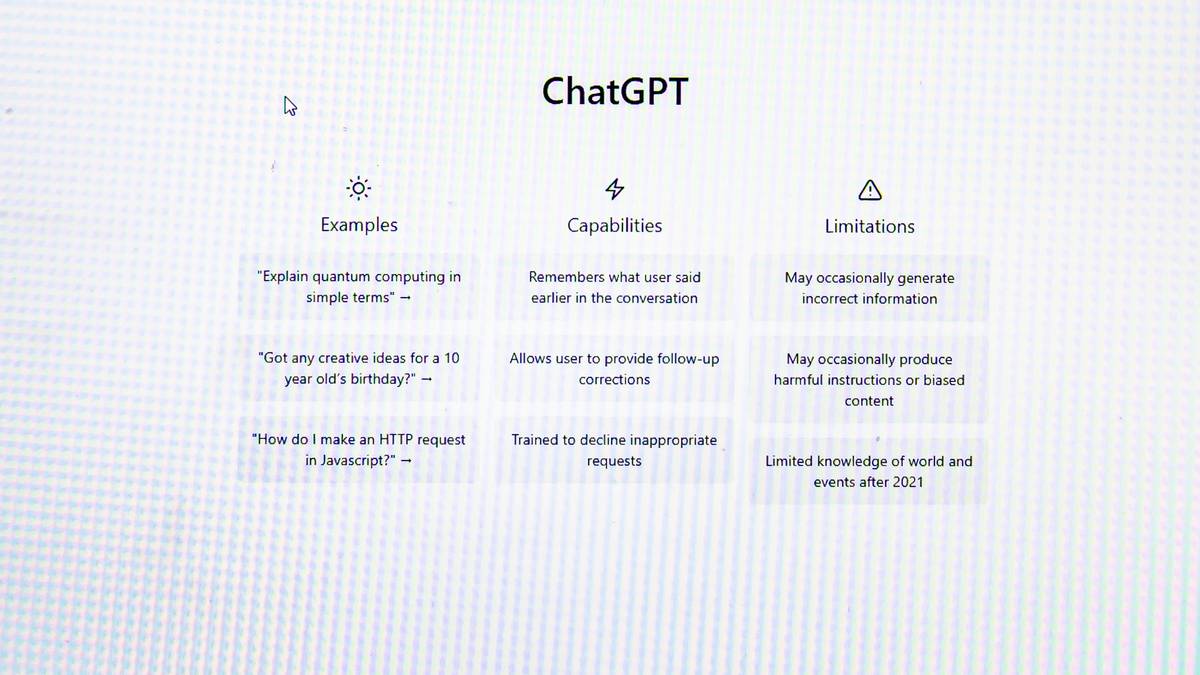

Det kan alltids hende vi kommer dit, men enn så lenge er det ikke noe i LLM-teknologien som gir stort håp om at dette er rett rundt hjørnet. I samme samtalen som jeg refererte til tidligere ba jeg chatgpt om å oppgi kilder. Det kunne den "certainly":Jeg ser et enormt potensial i AI til å tråle "all" kunnskap lynkjapt, noe som idag er umulig for et menneske, og å evaluere denne, før videre bearbeiding.

Problemet er at disse sitatene er fri fantasi. Det vet jeg, fordi jeg vet noe om hvordan hodetelefoner og en spinorama-rigg funker, og hva som er poenget med å gjennomføre en spinorama i utgangspunktet. Og fordi jeg googlet sitatene uten å få noen treff overhodet.

Mulig plugins kan rette opp i noe av dette, men LLM er ikke laget for å sammenholde påstander og resonnementer med sannheter. Den har ikke noe begrep om sannhet. Den er laget for å lage overbevisende tekst.

Jeg ga den en sjanse til:

Lenkene fører selvfølgelig ingensteds hen.

Poenget er at den tråler og tråler, men resultatet er ikke kunnskap.

Å basere seg på Google-søk er egentlig ille nok, men da finnes i det minste referansene uavhengig av om de inneholder fakta eller tull. Dette er så mye verre, og kan bidra til enda mindre opplyste diskusjoner. (Jeg bruker en del tid på Twitter, og det er ille nok nå.)Det kan alltids hende vi kommer dit, men enn så lenge er det ikke noe i LLM-teknologien som gir stort håp om at dette er rett rundt hjørnet. I samme samtalen som jeg refererte til tidligere ba jeg chatgpt om å oppgi kilder. Det kunne den "certainly":

Vis vedlegget 916995

Problemet er at disse sitatene er fri fantasi. Det vet jeg, fordi jeg vet noe om hvordan hodetelefoner og en spinorama-rigg funker, og hva som er poenget med å gjennomføre en spinorama i utgangspunktet. Og fordi jeg googlet sitatene uten å få noen treff overhodet.

Mulig plugins kan rette opp i noe av dette, men LLM er ikke laget for å sammenholde påstander og resonnementer med sannheter. Den har ikke noe begrep om sannhet. Den er laget for å lage overbevisende tekst.

Jeg ga den en sjanse til:

Vis vedlegget 917001

Lenkene fører selvfølgelig ingensteds hen.

Poenget er at den tråler og tråler, men resultatet er ikke kunnskap.

Kilde: chatgpt bør diskvalifisere deg fra alle diskusjoner.HHardingfele

Gjest

Men dette er ikke "kunstig intelligens" -- dette er "text autocomplete", basert på tekstfunn fra nettet, som synes relevante til en oppgave du har gitt innspill til.Det kan alltids hende vi kommer dit, men enn så lenge er det ikke noe i LLM-teknologien som gir stort håp om at dette er rett rundt hjørnet. I samme samtalen som jeg refererte til tidligere ba jeg chatgpt om å oppgi kilder. Det kunne den "certainly":

Vis vedlegget 916995

Problemet er at disse sitatene er fri fantasi. Det vet jeg, fordi jeg vet noe om hvordan hodetelefoner og en spinorama-rigg funker, og hva som er poenget med å gjennomføre en spinorama i utgangspunktet. Og fordi jeg googlet sitatene uten å få noen treff overhodet.

Mulig plugins kan rette opp i noe av dette, men LLM er ikke laget for å sammenholde påstander og resonnementer med sannheter. Den har ikke noe begrep om sannhet. Den er laget for å lage overbevisende tekst.

Jeg ga den en sjanse til:

Vis vedlegget 917001

Lenkene fører selvfølgelig ingensteds hen.

Poenget er at den tråler og tråler, men resultatet er ikke kunnskap.

Så må du fortsette å "prompte" og raffinere første bud, eventuelt.

Som du sikkert hørte i videoen med dem som kikket på "data-analysen", fikk to av deltakerne forskjellige svar på oppgaven de ga, med tanke på hva ChatGPT+ foreslo. Det er ikke som et låst leksikon, der det står samme tekst, samme hvem som slår opp i boken. Det er opp til deg som bruker å vurdere utfallet.Ja, det er derfor jeg mener at den ikke kan bli intelligent

Men fins det noe annet som er nærmere? Jeg kjenner ikke til noe.- Ble medlem

- 27.04.2019

- Innlegg

- 13.701

- Antall liker

- 33.490

- Sted

- Nordvest på Jæren

- Torget vurderinger

- 9

Er me i ferd med å passere nokre grenser, eller har me allereide tippa over?

iHUMAN - NRK TV

Kunstig intelligens forandrar verda. Sjå filmen med dei fremste på feltet, inkludert mannen bak ChatGPT, Ilya Sutskever.tv.nrk.no

Stanser utviklingen av Chat GPT

Teknologiselskapet setter utviklingen av Chat GPT på pause, etter bekymringsbrev fra 500 av verdens ledende teknologieksperter. – Dette gjør meg glad, sier KI-forsker Inga Strümke. www.nrk.no

www.nrk.no

I et foredrag ved MIT kommer Open Ai-sjef Sam Altman med en overraskende nyhet: selskapet stanser utviklingen på den populære tjenesten.

– I en tidlig versjon av brevet, sto det at vi holder på å trene GPT-5 akkurat nå. Det gjør vi ikke, og det kommer vi ikke til å gjøre på en god stund, sier Altman.

Årsaken er selvfølgelig at en større modell ikke kommer noe nærmere en bedre modell. GPT-5 ville blitt bedre til å fremstå som intelligent, men ikke kommet noe nærmere å være intelligent. Derfor sier også Altman "– Vi skal ikke lage større modeller. Vi skal lage dem bedre".

Jeg tror Emily Bender har rett i at LLMs har valgt feil metafysisk utgangspunkt hvis kunstig intelligens er målet. GPT er en fabelaktig bløffmaker som slumper til å gi nyttig informasjon, men intelligent er og blir den ikke.HHardingfele

Gjest

Nettopp. ChatGPT er autocomplete -- it's making a good guess as to what should be the next word in the sentence.

Stanser utviklingen av Chat GPT

Teknologiselskapet setter utviklingen av Chat GPT på pause, etter bekymringsbrev fra 500 av verdens ledende teknologieksperter. – Dette gjør meg glad, sier KI-forsker Inga Strümke. www.nrk.no

www.nrk.no

Årsaken er selvfølgelig at en større modell ikke kommer noe nærmere en bedre modell. GPT-5 ville blitt bedre til å fremstå som intelligent, men ikke kommet noe nærmere å være intelligent. Derfor sier også Altman "– Vi skal ikke lage større modeller. Vi skal lage dem bedre".

Jeg tror Emily Bender har rett i at LLMs har valgt feil metafysisk utgangspunkt hvis kunstig intelligens er målet. GPT er en fabelaktig bløffmaker som slumper til å gi nyttig informasjon, men intelligent er og blir den ikke.

Så spørs det hva vi mener med intelligens, for egentlig er dette nettopp hva vi alle gjør: gjenkjenner mønstre og vet hvilket ord som skal være det neste i en setning. Og jo bedre vi er til det, dess mer intelligente anses vi å være.

Vi har løst fordypningskravet ved spesialisering; LLM General Artificial Intelligence pløyer både dypt og bredt og nå er det nødvendig å raffinere resultatet.

Selv tror jeg at Altman også stanser videreutviklingen fordi nåværende ChatGPT produserer en mengde søppel inn i det som er tilfangsarenaen for ChatGPT. Det var en mengde søppel der fra før, men nå renner det over, fordi folk bruker ChatGPT for å generere innhold som skal gjøre det mulig å utnytte nettets annonseinntektspotensiale. Så det blir selvrefererende sludder.

De som arbeider med dette bør sette seg ned og lese Gödel, Escher, Bach.

God diskusjon her:

The Culture Creating A.I. Is Weird. Here’s Why That Matters.

Podkastepisode · The Ezra Klein Show · 2. mai 2023 · Kun for abonnenter · 1 t 5 min podcasts.apple.com

podcasts.apple.com

In recent months, we’ve witnessed the rise of chatbots that can pass law and business school exams, artificial companions who’ve become best friends and lovers and music generators that produce remarkably humanlike songs. It’s hard to know how to process it all. But if there’s one thing that’s certain, it’s this: The future — shaped by technologies like artificial intelligence — is going to be profoundly weird. It’s going to look, feel and function differently from the world we have grown to recognize.

How do we learn to navigate — even embrace — the weirdness of the world we’re entering into?

Erik Davis is the author of the books “High Weirdness: Drugs, Esoterica and Visionary Experience in the Seventies” and “TechGnosis: Myth, Magic and Mysticism in the Age of Information” and writes the newsletter “Burning Shore.” For Davis, “weirdness” isn’t just a quality of things that don’t make sense to us, it’s an interpretive framework that helps us better understand the cultures and technologies that will shape our wondrous, wild future.

We discuss how Silicon Valley’s particularly weird culture has altered the trajectory of A.I. development, why programs like ChatGPT can profoundly unsettle our sense of reality and our own humanity, how the behaviors of A.I. systems reveal far more about humanity than we like to admit, why we might be in a “sorcerer’s apprentice moment” for artificial intelligence, why we often turn to myth and science fiction to explain technologies whose implications we don’t yet grasp, why A.I. developers are willing to keep designing technologies that they think may destroy humanity and more.UUtgattmedlem 762

Gjest

Så deler av den. Det inntrykket som satt igjen sterkest var at dette var intelligente mennesker med veldig store selvbilder. Hva de tror, mener og frykter med AI synes mer enn noe å være farget av deres egne ego og troen på at de vil være dem det står om i fremtidens historiebøker som individene som forandret verden. Et ikke ukjent fenomen i Silicon Valley.Er me i ferd med å passere nokre grenser, eller har me allereide tippa over?

iHUMAN - NRK TV

Kunstig intelligens forandrar verda. Sjå filmen med dei fremste på feltet, inkludert mannen bak ChatGPT, Ilya Sutskever.tv.nrk.no

UUtgattmedlem 762

Gjest

Om den er/blir intelligent er vel mer enn noe et definisjonsspørsmål, og kanskje heller ikke et særlig viktig spørsmål. Det viktigste spørsmålet å stille seg mtp AI, er kanskje heller om den blir uforutsigbar. Dvs at vi ikke lenger forstår den og at den derfor gjør ting vi ikke kan forutse hva er og heller ikke kan forutse konsekvensene av. Om vi en dag kaller den intelligent, så kan det også bare bety at vi ikke lenger forstår den og ikke lenger kan avsløre om den bløffer eller ei.

Stanser utviklingen av Chat GPT

Teknologiselskapet setter utviklingen av Chat GPT på pause, etter bekymringsbrev fra 500 av verdens ledende teknologieksperter. – Dette gjør meg glad, sier KI-forsker Inga Strümke. www.nrk.no

www.nrk.no

Årsaken er selvfølgelig at en større modell ikke kommer noe nærmere en bedre modell. GPT-5 ville blitt bedre til å fremstå som intelligent, men ikke kommet noe nærmere å være intelligent. Derfor sier også Altman "– Vi skal ikke lage større modeller. Vi skal lage dem bedre".

Jeg tror Emily Bender har rett i at LLMs har valgt feil metafysisk utgangspunkt hvis kunstig intelligens er målet. GPT er en fabelaktig bløffmaker som slumper til å gi nyttig informasjon, men intelligent er og blir den ikke.

Jeg er ikke helt enig i det. Når vi skriver eller handler på noe som fremstår som en intelligent måte, så er det fordi det virker som vi har en intensjon med det vi gjør. Vi skriver noe for å kommunisere et eller annet, vi går en retning fordi vi har tenkt oss et sted.Så spørs det hva vi mener med intelligens, for egentlig er dette nettopp hva vi alle gjør: gjenkjenner mønstre og vet hvilket ord som skal være det neste i en setning. Og jo bedre vi er til det, dess mer intelligente anses vi å være.

Men begrepet er ikke veldig presist eller omforent, det er det ikke.

Dette er et problem dersom den har makt, og jeg tenker det vil være mer nærliggende å gi makt til et system som vi antar er intelligent.Det viktigste spørsmålet å stille seg mtp AI, er kanskje heller om den blir uforutsigbar.HHardingfele

Gjest

Intensjoner er så mangt. Hva er intelligent? En gang var det å kunne gjengi hva som stod i et konversasjonsleksikon, omkring et emne. Det er også en slags form for autocomplete.Jeg er ikke helt enig i det. Når vi skriver eller handler på noe som fremstår som en intelligent måte, så er det fordi det virker som vi har en intensjon med det vi gjør. Vi skriver noe for å kommunisere et eller annet, vi går en retning fordi vi har tenkt oss et sted.

Men begrepet er ikke veldig presist eller omforent, det er det ikke.

Danskene har et uttrykk: paratviden - å ha kunnskap klar på tungen, med null betenkningstid. Det anses å være et uttrykk for både intellektualitet, men også intelligens, siden intellektuering forutsetter relevant sortering.

Er intelligens å bedømme det som uttrykkes, og å kunne fastslå hva som er rett eller ikke? Vi er på et forum der ganske oppegående personer er uenige om det meste, inklusive retning på elektroner i en kabel, noe som vi faktisk har facit på.

Nå stiller folk banale spørsmål til ChatGPT og kommer med en dom på grunnlag av en første "prompt", dommen faller som regel med utgangspunkt i vedkommendes fordom omkring KI.

En av de første brukbare søkemotorene var AltaVista (du skulle altså få et overblikk), den søkte gjennom tilgjengelig kunnskap (og mange utgivere av trykte leksika sperret tilgang til deres tekster). Dermed var tilfangsarenaen for AltaVista begrenset og folk felte en dom utfra dette.

Det samme ble Wikipedia utsatt for, spesielt i begynnelsen, og på en del kontroversielle emner foregår hyppig redigering av innhold fortsatt, men det viser seg at denne redigeringen fører til en forbedring av innholdet, samtidig som det også viser til alternative innfallsvinkler til samme.

ChatGPT og andre AI-funksjoner tråler "all" tilgjengelig informasjon og bearbeider denne, utfra det vi enkelt kan kalle et søk, men ordet "intelligens" misviser, siden vi har et diffust begrep om hva som utgjør intelligens. (Du får garantert tyve ulike svar fra tyve ulike personer, om du "prompter" dem tilstrekkelig, om du ber dem definere hva intelligens er).

Når folk skriver "jeg tar det helt med ro når det gjelder KIs evne til å erstatte jobber", bør de sannsynligvis ettergå nøyaktig hva det er de gjør som er uinntakelig for en KI-prosess. Dersom det de gjør er å forsøke å levere et saksrelevant utdrag fra sitt overblikk innen et fagfelt bør de gå stillere i dørene. Dette overblikket er ikke, i seg selv, et tegn på intelligens, men på innsikt og de vi nå kritiserer eller applauderer ved KI er grad av kjapp innsikt i mange emner, på mange ulike språk, levert på sekunder. Slike prosesser utgjør en stor prosentandel av jobboppgavene man forsøker å få bedre betalt for på LinkedIn.

Kan KI være disruptivt? Det er det allerede. For mange er intelligens gjerne omkalfatrende disruptiv og det vil jeg si vi står overfor nå, en omkalfatring av verdifastsettelsen på overblikksinnsikt i ulike områder man hittil trodde var vernet fra å skulle bli overtatt av "maskiner".

Skal vi diskutere KI, bør vi også være enige om hva vi snakker om: er det problemløsning (gjerne en iterativ oppgave som bygger forbi kjent kunnskap), er det informasjonsinnhenting og bearbeiding, er det språkemulering ... og hvor langt er vi fra helt nye begrepsformer og design vi ikke kunne forestilt oss?

Her er en Aerospike rakettmotor som er blitt designet av kunstig intelligens, for å sørge for at den er selvkjølende uansett hvor hardt du kjører den, samtidig som den takler de ulike oppgavene en rakettmotor nå designes for (take-off, second-stage, vakuum krever ulike løsninger nå).

Er dette intelligent?

- Ble medlem

- 27.04.2019

- Innlegg

- 13.701

- Antall liker

- 33.490

- Sted

- Nordvest på Jæren

- Torget vurderinger

- 9

Det får jo konsekvenser for oss alle etterkvart.

IBM skal erstatte flere tusen jobber med kunstig intelligens

7800 jobber kan forsvinne, ifølge sjefen selv.www.digi.no

UUtgattmedlem 762

Gjest

Men nye jobber vil dukke opp, noen må jo kvalitetssikre alt dette som AIene genererer.

Det har vært mange disruptive teknologier og oppfinnelser opp gjennom tidene; bil, traktor, TV, internett, roboter og så videre. Men absolutt ingen har ført til netto reduksjon i arbeidsbehovet. Kusken ble overflødig da bilen kom, men arbeidsmarkedet bare endret seg. Det forsvant ikke, det har aldri skjedd.En kan jo håpe at det nærmer seg slutten for sk. "bullshit jobs", men ideen om evig vekst sikrer at folk må jobbe.

Jeg synes du har mange gode poenger og vi ser veldig likt på det. Akkurat denne uttalelsen synes jeg er interessant, for den speiler så godt hva KI-makerne tenker og også hvorfor de tar feil. På begynnelsen av det tyvende århundre foregikk det en "språklig vending" i filosofien, der sentrale tenkere som Saussure, Wittgenstein, Rorty og Derrida la en haug med arbeid ned i å vise hvordan språk og tenking er to sider av samme sak. Det er mye klokt i det, og det er også derfor GPT fungerer så bra som det gjør. Men det har gått noe tapt i overgangen fra den språklige vendingen, og det er at språket har et "overskudd av mening", altså at språk bare kan forstås om man også forstår at ikke alt kan formidles i språk.ChatGPT og andre AI-funksjoner tråler "all" tilgjengelig informasjon og bearbeider denne

Poenget er at GPT anser "all informasjon" som lik "all nedskreven tekst", men det stemmer jo ikke. Mange filosofers forskningstid går med på å diskutere qualia – hvordan det kan ha seg at alle vet hva smerte er, men at jeg ikke aner om min smerte er lik din.HHardingfele

Gjest

Og det er vel nettopp overgangen til qualia som AI-forskningen søker å oppnå, hvorvidt de vil lykkes (vil annonsere at de har klart det) gjenstår å se/oppleve/oppdage.En kan jo håpe at det nærmer seg slutten for sk. "bullshit jobs", men ideen om evig vekst sikrer at folk må jobbe.

Jeg synes du har mange gode poenger og vi ser veldig likt på det. Akkurat denne uttalelsen synes jeg er interessant, for den speiler så godt hva KI-makerne tenker og også hvorfor de tar feil. På begynnelsen av det tyvende århundre foregikk det en "språklig vending" i filosofien, der sentrale tenkere som Saussure, Wittgenstein, Rorty og Derrida la en haug med arbeid ned i å vise hvordan språk og tenking er to sider av samme sak. Det er mye klokt i det, og det er også derfor GPT fungerer så bra som det gjør. Men det har gått noe tapt i overgangen fra den språklige vendingen, og det er at språket har et "overskudd av mening", altså at språk bare kan forstås om man også forstår at ikke alt kan formidles i språk.

Poenget er at GPT anser "all informasjon" som lik "all nedskreven tekst", men det stemmer jo ikke. Mange filosofers forskningstid går med på å diskutere qualia – hvordan det kan ha seg at alle vet hva smerte er, men at jeg ikke aner om min smerte er lik din.

Google mener visst nei. Han de sparket mener ja.

HHardingfele

Gjest

Om intelligens. Ted Chiang skrev "The great silence" om mennesker som lytter etter tegn på intelligent liv i verdensrommet, når det befinner seg i et tre ved siden av observatoriet.

Interessant perspektiv ikke bare på AI, men hele tech-bransjen.

253. The Cold War Origins and Future of Today’s AI

Podcast Episode · This Machine Kills · 6 May 2023 · 1hr 27min podcasts.apple.com

podcasts.apple.com

- Ble medlem

- 23.03.2006

- Innlegg

- 21.014

- Antall liker

- 12.296

Blir man seende ut slik når man spiser denne pizzaen?HHardingfele

Gjest

Tips til læreplanansvarlige i norsk skolevesen: sørg for at barn ikke kaster bort tiden på å lære seg "koding".

HHardingfele

Gjest

Som sagt, sørg for at barn ikke lærer seg koding.

Code Interpreter tar jobben.

HHardingfele

Gjest

En videreføring av en av løsningene vist til i innlegget over. AIen kom opp med et elegant bevis på hvorfor jorden ikke kan være flat, og ble bedt om å kjøre prosessen vha python, noe den gjorde med selvkorrigering på veien.

Som det står: hvor er vi om seks måneder?

Kan du skrive en rutine som multipliserer to 8-bits heltall? Rutinen skal skrives i 6800 assembler.

Ja, her er en rutine som multipliserer to 8-bits heltall i 6800 assembler:

; Multipliserer to 8-bits heltall (x og y)

; Resultatet lagres i registrene A og B

MULT:

LDAA 0,X ; Last inn x fra minneadresse X

LDX #1,X ; Sett X til å peke på y

CLRA ; Nullstill register A

CLRB ; Nullstill register B

MULT_LOOP:

ADDA 0,X ; Legg til y til A

BCC MULT_SKIP ; Hopp til MULT_SKIP hvis det ikke skjer en carry

INCB ; Øk B med 1 hvis det er en carry

MULT_SKIP:

INX ; Øk X med 1 for å peke på neste byte av y

DECA ; Reduser A med 1

BNE MULT_LOOP ; Hopp til MULT_LOOP hvis A er ulikt null

RTS ; Returner fra rutinen

La meg forklare hva koden gjør trinn for trinn:

1. LDAA 0,X laster inn x fra minneadressen som er pekt på av X.

2. LDX #1,X setter X til å peke på y.

3. CLRA og CLRB nullstiller registrene A og B, som vil brukes til å beregne produktet.

4. ADD A 0,X legger til y til register A.

5. BCC MULT_SKIP hopper til MULT_SKIP hvis det ikke skjer en carry.

6. INCB øker register B med 1 hvis det skjer en carry.

7. INX øker X med 1 for å peke på neste byte av y.

8. DECA reduserer register A med 1.

9. BNE MULT_LOOP hopper til MULT_LOOP hvis register A er ulikt null.

10. RTS returnerer fra rutinen.

For å bruke denne rutinen kan du lagre de to 8-bits heltallene du vil multiplisere i minne, og deretter kalle rutinen med X satt til adressen av det første tallet. Resultatet vil bli lagret i registrene A og B.

Jeg har gått gjennom svaret som ChatGPT produserte på en overbevisende måte, men resultatet er ganske nedslående. Det er noen år siden jeg drev med slike ting, men jeg tror jeg husker såpass mye at jeg greier å skille snørr og fantasi.

I adresse X og X+1 ligger tallene x og y (8-bits heltall) som skal multipliseres.

La oss si at tallene er x=20 og y=4. (verdien brukes bare for å illustrere).

Vi setter index-registeret X til å peke på adressen til første tallet, vi velger at dette er adresse 10.

Så kaller vi rutinen som ChatGPT har skrevet.

Den første delen av rutinen, ned til label MULT_LOOP, kjøres kun en gang.

Innholdet i A, B og X blir da:

A = 0

B = 0

X = 11

OBS:

LDX #1,X ; Sett X til å peke på y

Kommentaren til ChatGPT er feil, X settes ikke til å peke på y, men X lastes med innholdet av adresse X+1, som er adresse 11 siden vi satte X = 10. Innholdet av adresse 11 er 4, vår y-variabel.

Men la oss si at vi X peker på y, slik at vi kommer videre.

En kan jo også lure på hvorfor A først lastes med innholdet av X (LDAA 0,X) for deretter å settes til 0 (CLRA), men det er hva det er.

Ved første gjennomkjøring av MULT_LOOP

A = 4 (ADDA 0,X) (X er her 11)

X = 12 (INX)

A = 3 (DECA)

Index-registeret X inkrementeres angivelig for peke på neste byte av y, men det finnes jo ingen neste byte av y. Et 8-bits heltall består som kjent av kun en byte.

Når X inkrementeres for hver gang loopen kjøres, vil X neste gang peke ut i ukjent terreng..

Før eller siden, hvis tilfeldighetene tillater det, vil A addere seg opp til 0 og BNE vil ikke fortsette loopen og rutinen vil returnere.

I register A og B vil det nå ligge 0 i A og en tilfeldig verdi i register B, men ikke produktet av variablene x og y.

Man skal ikke henge seg opp i syntaks for den kan jo være litt forskjellig fra assembler til assembler, men det er vanskelig å finne den logiske oppbyggingen av denne rutinen og hvordan den er tenkt å skulle virke.HHardingfele

Gjest

Enn venn brukte én dag på å lage et detaljert "treatment" til en spillefilm, med AI-genererte bilder fra handlingen. Da han viste pdf'en i et produksjonsselskap fikk han spørsmål om hvilken film han hadde hentet de fotorealistiske bildene fra -- "de lagde jeg med AI".

Nå er han nedsnødd i slike oppgaver. (Dette var med MidJourney).

Chat GPT+ er blitt direktekoblet til internettet.

Det er ikke tvil om at det kan være et ekstremt kraftig verktøy. Et vesentlig problem så langt er at modellene er trent på materiale som gjerne er kopibeskyttet...Enn venn brukte én dag på å lage et detaljert "treatment" til en spillefilm, med AI-genererte bilder fra handlingen. Da han viste pdf'en i et produksjonsselskap fikk han spørsmål om hvilken film han hadde hentet de fotorealistiske bildene fra -- "de lagde jeg med AI".

Nå er han nedsnødd i slike oppgaver. (Dette var med MidJourney).

Chat GPT+ er blitt direktekoblet til internettet.

hjemmeeksamenens dager er talteUUtgattmedlem 762

Gjest

WATCH: AI era, Coca Cola uses stable diffusion plus tradition in new advert

Their use of AI in their latest add offering, shows a blend of AI in the form of Stable Diffusion, 3D and traditional methods to produce what could be a creative compelling delivery from Coca-Cola. memeburn.com

memeburn.com

Kul reklame.

det er å håpe (i en del tilfeller). dessverre tror jeg at det eneste som er gangbar mynt er utgifter i forbindelse med eksamen. hjemmeeksamen er billig!hjemmeeksamenens dager er talteDet er billig og enkelt. Ofte er det også den vurderingsformen som passer best med arbeidsformen gjennom semesteret, særlig hvis det en holder på med er å skrive lengre tekster.UUtgattmedlem 762

Gjest

The Beatles Release Their Final Song, Now And Then - And We Have AI To Thank - BGR

Now and Then, the final song from The Beatles, adds a sweetly satisfying, nostalgia-laden coda to the story of the Fab Four. bgr.com

bgr.com

- Ble medlem

- 27.04.2019

- Innlegg

- 13.701

- Antall liker

- 33.490

- Sted

- Nordvest på Jæren

- Torget vurderinger

- 9

Kunstig intelligens kan ikke erstatte menneskelig kreativitet

KRONIKK: Kunstig intelligens kan ikke erstatte banebrytende menneskelig kreativitet, men understøtte og forbedre menneskers kreative problemløsning. forskersonen.no

H

forskersonen.no

HHardingfele

Gjest

HHardingfele

Gjest

Og en del uro blant grafikkarbeidere etter Adobe Photoshops nye betaversjon, som viser hvordan én dags arbeid reduseres til 10 sekunder.

- Ble medlem

- 24.08.2018

- Innlegg

- 4.822

- Antall liker

- 3.163

De som uttaler seg skråsikkert om utviklerrollen og behovet for kodere i denne tråden har åpenbart ikke særlig peiling. Vi som jobber med utvikling er ikke spesielt bekymret, heller ikke for våre barn. -

Laster inn…

Diskusjonstråd Se tråd i gallerivisning

-

-

Laster inn…